Xiaomi macht jetzt KI: MiMo-V2-Flash startet mit beeindruckenden Benchmarks

Xiaomi ist eigentlich für Smartphones und smarte Technik bekannt, möchte jetzt aber mit dem MiMo-V2-Flash KI-Modell auch im Bereich der künstlichen Intelligenz ganz oben mitmischen. Dabei verspricht der Hersteller ein leistungsfähiges Sprachmodell, das Open-Source ist und technisch mit den teuersten Lösungen am Markt mithalten soll. Ist das Xiaomis Deepseek-Moment?

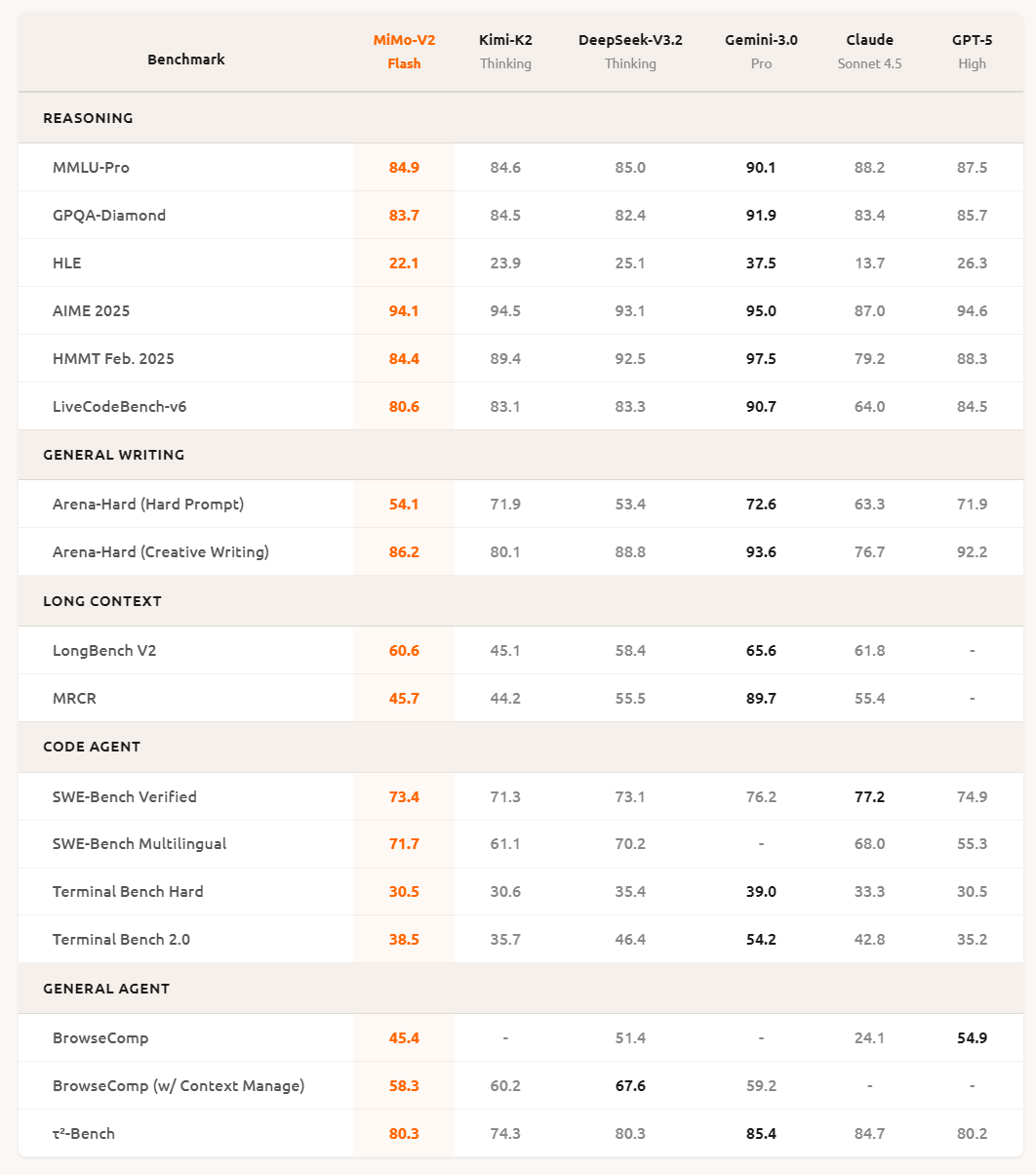

Der Vergleich: Xiaomi vs. die Giganten

Xiaomi scheut den Vergleich nicht und stellt sein neues Modell direkt gegen die aktuellen Marktführer wie GPT-5 (High), Claude Sonnet 4.5 oder Gemini 3.0 Pro. Das Ziel ist klar: Man will zeigen, dass man nicht nur „gut für ein Open-Source Modell“ ist, sondern in der ersten Liga spielt.

In den Xiaomi-Benchmarks sieht das durchaus beeindruckend aus:

- Logik & Mathe: Im AIME 2025 Mathe-Wettbewerb erreicht der Xiaomi-Algorithmus 94,1 Punkte und liegt damit quasi gleichauf mit GPT-5 High (94,6) und schlägt DeepSeek-V3.2 (93,1).

- Programmieren: Beim Coden (SWE-Bench Verified) holt sich das Modell mit 73,4 % den Spitzenplatz unter den Open-Source-Modellen und kommt gefährlich nah an die kommerzielle Spitze heran.

- Alltagswissen: In Tests wie MMLU-Pro, die allgemeines Wissen abfragen, spielt man mit 84,9 Punkten ebenfalls im oberen Feld mit.

Man muss aber schon sagen, dass Xiaomi weiterhin unterhalb des stärksten Allrounders Gemini 3.0 Pro steht und beim Coding auch Claude Sonnet 4.5 unterliegt. Auch scheint das kreative Schreiben nicht die Stärke dieses Modells zu sein, da es in diesen Benchmarks hier schlechtere Werte im Vergleich erreicht. Besonders spannend für Nutzer: Xiaomi bietet das Modell als API-Onlineservice deutlich günstiger an als die Konkurrenz – oder als Open-Source-Variante sogar komplett gratis zur eigenen Verwendung. Für letzteres braucht es dann aber auch die entsprechende Hardware, um ein solches Modell lokal betreiben zu können. Damit folgt man dem Trend der chinesischen KI-Landschaft und auch der eigenen Praxis vom ersten eigenen Modell.

Xiaomis Modell: Effizienter und schneller?

Um die Effizienz des hauseigenen Modells zu erhöhen, nutzt Xiaomi verschiedene Techniken, darunter eine Mixture-of-Experts (MoE) Architektur und die Multi-Token Prediction. Dadurch soll es möglich sein, sehr schnelle 150 Token pro Sekunde zu erreichen und gleichzeitig die Kosten zu senken. Die Token pro Sekunde sind die Geschwindigkeit, mit der ein Sprachmodell Text während der Generierung verarbeitet und ausgibt.

Das Modell verfügt über einen Hybrid Thinking Mode. Ihr könnt also entscheiden, ob die KI sofort antworten soll oder sich ähnlich wie aktuelle Top-Modelle erst Zeit zum „Nachdenken“ nimmt, um komplexe Probleme zu lösen. Zudem hat es ein 256k Context Window. Einfach gesagt: Es kann sich viel Text merken.

Durch diese Effizienztricks verspricht Xiaomi, die Kosten massiv zu drücken. Die Nutzung über die Schnittstelle (API) kostet nur 0,10$ pro eine Million Eingabe-Tokens und 0,30$ pro eine Million Ausgabe-Tokens. (Deepseek vorher am günstigsten: Input: 0,28$ / Output: 0,42$) Das ist im Vergleich zu anderen Modellen fast geschenkt und macht es für Bastler und Entwickler extrem attraktiv.

Starke Leistung für wenig Geld?

Mit dem MiMo-V2-Flash liefert Xiaomi ein Paket ab, das zumindest nach den eigenen Benchmarks schon ziemlich vielversprechend klingt. Bevor man jetzt aber voreilige Schlüsse trifft, sollte man noch unabhängige Tests abwarten.

Die Kombination aus der hohen Geschwindigkeit (150 Tokens/s) und der Fähigkeit, komplexe Coding- und Mathe-Aufgaben zu lösen, macht es in der Theorie aber sicherlich zum gefährlichen Gegner bestehender Modelle. Ähnlich wie Deepseek kommt man auch hier mit dem großen Argument der monetären Kosten. Dass Xiaomi das Ganze dann auch noch als Open-Source (MIT Lizenz) veröffentlicht und Schnittstellen für gängige Coding-Tools (wie Cursor) anbietet, zeigt, dass man hier ernsthaft die Entwickler-Community abholen will.

Quelle:

Hier geht's zum GadgetWenn du über einen Link auf dieser Seite ein Produkt kaufst, erhalten wir oftmals eine kleine Provision als Vergütung. Für dich entstehen dabei keinerlei Mehrkosten und dir bleibt frei wo du bestellst. Diese Provisionen haben in keinem Fall Auswirkung auf unsere Beiträge. Zu den Partnerprogrammen und Partnerschaften gehört unter anderem eBay und das Amazon PartnerNet. Als Amazon-Partner verdienen wir an qualifizierten Verkäufen.

Sortierung: Neueste | Älteste

Kommentare (2)